V digitálnom svete, kde sú dáta cenným zdrojom, sa stáva efektívna ochrana pred neoprávneným získavaním informácií kľúčovou. Jedným z inovatívnych prístupov k tejto problematike je systém známy ako "exorcizmus" v kontexte webových technológií, pričom sa ako príklad uvádza metóda Anubis. Táto metóda sa zameriava na detekciu a odradenie automatizovaných skriptov, známych ako "scrappers", ktoré sa snažia vo veľkom rozsahu získať obsah z webových stránok. Hoci sa na prvý pohľad môže zdať, že zvýšená záťaž na jednotlivca je zanedbateľná, pri masovom nasadení týchto skriptov sa stáva významným faktorom, ktorý predražuje proces získavania dát.

Princípy fungovania Anubisu a jeho vplyv na scraping

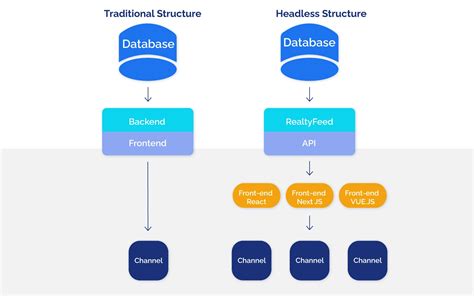

Anubis predstavuje riešenie, ktoré má slúžiť ako dočasná prekážka pre automatizované systémy. Jeho hlavným cieľom je získať viac času na vývoj sofistikovanejších metód na identifikáciu a rozlíšenie medzi legitímnymi používateľmi a "headless" prehliadačmi. Headless prehliadače sú špeciálne nástroje, ktoré spúšťajú webové stránky bez grafického rozhrania, čo ich robí ideálnymi pre automatizované úlohy, ako je práve scraping. Jednou z metód detekcie headless prehliadačov je analýza ich správania pri vykresľovaní fontov. Rozdiely v tom, ako tieto prehliadače interpretujú a zobrazujú písma, môžu byť kľúčovým indikátorom ich nelegitímnej povahy.

Myšlienka spočíva v tom, že na individuálnej úrovni je dodatočná záťaž, ktorú Anubis spôsobuje, zanedbateľná. Teda pre bežného používateľa stránky je tento proces takmer nepostrehnuteľný. Avšak, keď sa masové skenery pokúšajú získať dáta vo veľkom rozsahu, táto záťaž sa kumuluje. Každý jednotlivý požiadavok, ktorý musí spracovať systém Anubis, predstavuje dodatočný výpočtový čas a zdroje. Pri miliónoch takýchto požiadavkov, ktoré generujú rozsiahle scrapingové operácie, sa táto záťaž stáva významnou, čím sa výrazne zvyšujú náklady na prevádzku týchto skriptov. Tento rast nákladov môže byť dostatočne odradzujúcim faktorom pre mnohých prevádzkovateľov scraperov.

Technické požiadavky a obmedzenia Anubisu

Je dôležité poznamenať, že Anubis si vyžaduje používanie moderných funkcií JavaScriptu. Toto je kľúčový aspekt, ktorý zároveň predstavuje jedno z jeho obmedzení. Mnohé pluginy a rozšírenia prehliadačov, ktoré sú zamerané na zvýšenie súkromia a bezpečnosti používateľov, ako napríklad JShelter, často tieto moderné JavaScriptové funkcie blokujú alebo modifikujú. Dôvodom pre ich blokovanie je často snaha zabrániť sledovaniu a identifikácii používateľa prostredníctvom pokročilých techník, ktoré moderný JavaScript umožňuje.

Avšak, práve tieto moderné funkcie sú nevyhnutné pre správne fungovanie Anubisu. Ak používateľ používa plugin, ktorý zakáže funkcie potrebné pre Anubis, systém nemusí byť schopný správne fungovať a detekovať potenciálne škodlivé skripty. Toto vytvára zaujímavú dilemu: na jednej strane chceme chrániť používateľov pred sledovaním a potenciálnym zneužitím ich dát, na druhej strane technológie na ochranu súkromia môžu neúmyselne oslabiť obranu webových stránok pred automatizovaným zneužívaním.

Z tohto dôvodu je vývoj smerom k presnejšiemu "fingerprintingu" (odfľaknutiu) a identifikácii headless prehliadačov nevyhnutný. Namiesto spoliehania sa na dočasné riešenia, ako je zvýšená výpočtová záťaž, sa vývojári snažia nájsť spôsoby, ako priamo rozpoznať, či sa jedná o skutočného používateľa alebo automatizovaný skript. Metódy, ako je analýza vykresľovania fontov, sú len jedným z príkladov takýchto pokročilých techník. Cieľom je, aby sa stránka s výzvou na overenie "proof of work" (dôkaz práce) zobrazovala len tým používateľom, ktorí sú s vysokou pravdepodobnosťou legitímni. Tým sa minimalizuje frustrácia pre bežných používateľov a zároveň sa maximalizuje efektivita ochrany proti scraperom.

Výzvy a budúcnosť ochrany webových stránok

Problém automatizovaného získavania dát je neustále sa vyvíjajúci. Prevádzkovatelia scraperov neustále hľadajú nové spôsoby, ako obísť bezpečnostné opatrenia. Preto je vývoj v oblasti detekcie a obrany nepretržitý proces. Okrem technických metód, ako je analýza JavaScriptu a fingerprinting, sa skúmajú aj iné prístupy. Napríklad analýza sieťovej prevádzky, správania pri interakcii s webovou stránkou (napr. rýchlosť pohybu myši, čas strávený na stránke) alebo dokonca aj analýza hardvérových charakteristík, ak sú dostupné, môžu pomôcť pri rozlišovaní medzi človekom a strojom.

V širšom kontexte, táto snaha o ochranu pred scrapingom odráža rastúcu hodnotu digitálnych dát a potrebu ich regulácie. Webové stránky, ktoré poskytujú cenné informácie, sa stávajú cieľom pre rôzne subjekty, od konkurenčných firiem až po výskumné inštitúcie. Zatiaľ čo etické získavanie dát pre výskumné účely je často vítané, masívne komerčné scrapingové operácie, ktoré môžu vyčerpať zdroje webovej stránky alebo zneužiť jej obsah, sú problematické. Preto sa technológie ako Anubis stávajú dôležitou súčasťou arzenálu na ochranu digitálnych aktív.

Je dôležité, aby sa pri vývoji týchto ochranných mechanizmov dbalo na rovnováhu medzi bezpečnosťou a použiteľnosťou. Príliš agresívne opatrenia môžu odradiť aj legitímnych používateľov, zatiaľ čo nedostatočné opatrenia môžu viesť k zneužitiu. Budúcnosť spočíva v inteligentných, adaptívnych systémoch, ktoré dokážu rozpoznať anomálie v správaní a reagovať na ne primerane, čím sa zabezpečí hladký chod webových stránok pre všetkých používateľov.

tags: #exorcizmus #molly #hartley #csfd